Neutrofile to komórki, zaliczane do leukocytów, które pełnią istotną rolę w procesach odpornościowych. O jakich schorzeniach może świadczyć obniżenie liczby neutrofili we krwi? Czy wzrost ich liczby wiąże się tylko z infekcjami bakteryjnymi? Dowiedz się więcej na temat neutrocytów.

Spis treści:

- Neutrofile – co to jest?

- Podwyższone lub obniżone neutrocyty we krwi – co oznacza wynik badania?

- Poziom neutrofili poniżej normy u dziecka lub podwyższone. Jak zinterpretować wyniki badań?

- Obniżone lub podwyższone stężenie neutrocytów w ciąży. Czy jest groźne?

- Czy poziom neutrofili można ustabilizować?

Neutrofile – co to jest?

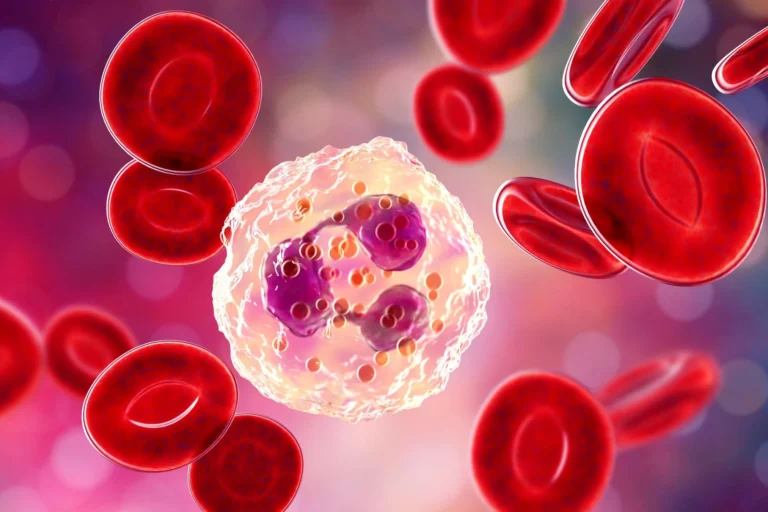

Neutrofile (neutrocyty) to jeden z rodzajów leukocytów, a więc krwinek białych. Komórki te nazywane są również granulocytami obojętnochłonnymi.

Neutrocyty to najliczniejsza populacja leukocytów – komórki te stanowią bowiem aż 50-70% wszystkich krwinek białych. Neutrofile należą do granulocytów, a więc krwinek białych, które cechują się licznymi ziarnistościami w cytoplazmie komórkowej. Oprócz neutrofili do tej grupy zaliczamy również eozynofile i bazofile. Komórki te produkowane są w szpiku kostnym.

W prawidłowych warunkach neutrofile krążą we krwi obwodowej, jednak mogą również wędrować do narządów i tkanek.

>> Przeczytaj też: Bazofile we krwi – jak interpretować wyniki badania?

Za co odpowiadają neutrofile?

Neutrofile odgrywają niezwykle istotną rolę w procesach odpornościowych przebiegających w organizmie człowieka. Neutrocyty odpowiedzialne są między innymi za:

- proces fagocytozy patogenów – reakcja ta polega na pochłanianiu patogenów lub ich fragmentów oraz ich „unicestwianiu”,

- unieszkodliwianie patogenów z wykorzystaniem enzymów o działaniu przeciwbakteryjnym przeciwwirusowym i przeciwgrzybiczym,

- zwalczanie patogenów z wykorzystaniem reaktywnych form tlenu (reakcje wybuchu tlenowego),

- wiązanie żelaza – w neutrofilach znajduje się białko nazywane laktoferyną, które zdolne jest do wiązania żelaza, a więc mikroelementu, który jest niezbędny do życia niektórym gatunkom bakterii.

>> To może Cię zainteresować: Żelazo – zapotrzebowanie, źródła w diecie, niedobór i nadmiar

Jakie badanie pozwala zbadać poziom neutrocytów we krwi?

Badaniem, które pozwala na określenie liczby neutrofili we krwi, jest morfologia krwi obwodowej z rozmazem automatycznym. Badanie to jest podstawowym badaniem laboratoryjnym, które pozwala również na ocenę liczby pozostałych rodzajów leukocytów oraz – między innymi – na oznaczenie liczby erytrocytów, leukocytów, płytek krwi, a także stężenia hemoglobiny.

Morfologia jest wykonywana z próbki krwi żylnej i nie wymaga od pacjenta specjalnego przygotowania. Przed udaniem się na badanie najlepiej pozostać na czczo, a poprzedniego dnia zjeść lekką kolację.

>> Przeczytaj też: PDW (wskaźnik anizocytozy płytek krwi) – badanie, podwyższone i obniżone wskaźniki, interpretacja wyników

Podwyższone lub obniżone neutrocyty we krwi – co oznacza wynik badania?

Obniżenie i podwyższenie liczby neutrofili może towarzyszyć wielu jednostkom chorobowym. Samo odchylenie w liczbie neutrofili nie pozwala na ustalenie konkretnego rozpoznania. Badanie to należy interpretować w połączeniu z innymi badaniami laboratoryjnymi lub obrazowymi. Należy wziąć również pod uwagę obraz kliniczny prezentowany przez pacjenta.

Jakiekolwiek odchylenia w morfologii krwi obwodowej powinny być interpretowane w gabinecie lekarskim. W pierwszej kolejności należy udać się do lekarza rodzinnego lub internisty.

>> Przeczytaj też: Neutropenia – niski poziom neutrofili. Przyczyny, objawy, leczenie

Podwyższone neutrofile. Co wpływa na wzrost stężenia granulocytów obojętnochłonnych?

Podwyższona liczba neutrofili we krwi obwodowej nazywana jest w mianownictwie medycznym neutrofilią. Neutrofilia towarzyszy takim stanom klinicznym jak:

- ostre zakażenia bakteryjne,

- białaczka,

- niektóre schorzenia reumatologiczne, w tym RZS, a więc reumatoidalne zapalenia stawów, układowe zapalenia naczyń,

- silne krwotoki, związane z dużą utratą krwi,

- przyjmowanie niektórych leków, w tym glikokortykosteroidów,

- nadczynność kory nadnerczy,

- zatrucia, w tym tlenkiem węgla,

- uszkodzenia narządów i tkanek, w tym zawał mięśnia sercowego, choroby zapalne jelit, stan po ważnych zabiegach chirurgicznych,

- cukrzyca,

- stan po splenektomii, a więc usunięciu śledziony,

- napad dny moczanowej,

- ostre zapalenie trzustki,

- ciąża, poród,

- przełom tarczycowy,

- stan po intensywnym wysiłku fizycznym.

Sprawdź także:

>> Czym jest RZS? Jak często występuje, kogo dotyka?

>> Wczesne zapalenie stawów (WZS) – dlaczego ważne jest wczesne postawienie diagnozy?

Neutrocyty poniżej normy. Co wpływa na spadek stężenia granulocytów obojętnochłonnych?

Obniżona liczba granulocytów obojętnochłonnych nazywana jest neutropenią. Neutropenia towarzyszy takim sytuacjom klinicznym, jak np.:

- niedokrwistość aplastyczna (a więc związaną z niewydolnością szpiku kostnego),

- infekcja wirusowa,

- włóknienie szpiku,

- gruźlica,

- leczenie przeciwnowotworowe (chemioterapia, radioterapia),

- przyjmowanie niektórych leków, w tym: niektórych leków przeciwpadaczkowych, tyreostatyków, penicyliny, sulfonamidy,

- niedobór witaminy B12 lub kwasu foliowego,

- neutropenia autoimmunologiczna,

- niektóre ostre białaczki.

>> Przeczytaj również: Białaczka (leukemia, rak krwi) – objawy, rodzaje, diagnostyka i leczenie

Poziom neutrofili poniżej normy u dziecka lub podwyższone. Jak zinterpretować wyniki badań?

Zmiany liczby neutrofili u dzieci są najczęściej związane z infekcjami. W przypadku infekcji bakteryjnych obserwuje się typowo wzrost ich liczby, z kolei w trakcie infekcji wirusowych – spadek liczby neutrocytów, a więc neutropenię. Należy jednak wyraźnie podkreślić, że wszelkie niepokojące objawy i odchylenia w badaniach laboratoryjnych u najmłodszych należy konsultować z lekarzem pediatrą. Uwagę powinno zwrócić przede wszystkim znaczne obniżenie liczby neutrofili i częste infekcje, ale również przewlekłe utrzymywanie się nieprawidłowej liczby neutrocutów w wyniku morfologii krwi obwodowej.

Obniżone lub podwyższone stężenie neutrocytów w ciąży. Czy jest groźne?

Okres ciąży to taki czas, w którym w organizmie kobiety zachodzi wiele zmian. Dotyczy to również funkcjonowania układu immunologicznego. W czasie ciąży obserwuje się wzrost produkcji neutrofili i spadek ich apoptozy – a więc „zaprogramowanej” śmierci.

Jak pokazują doniesienia naukowe, w okresie ciąży neutrocyty wykazują zachowanie określane mianem chemotaksji i przemieszczają się do miejsca, gdzie toczy się stan zapalny. Procesem tym steruje hormon – progesteron. Ma to na celu zapobieganie nadmiernej reakcji immunologicznej przeciwko rozwijającemu się płodowi.

| Warto wiedzieć: Okres ciąży wiąże się ze zwiększeniem tolerancji immunologicznej, co ma na celu zapobieganie odrzucaniu płodu. |

Czy poziom neutrofili można ustabilizować?

Ustabilizowanie liczby neutrofili wymaga leczenia choroby podstawowej, która spowodowała wystąpienie tego odchylenia. Neutrofilia i neutropenia nie są schorzeniami samymi w sobie, lecz objawami laboratoryjnymi innych stanów klinicznych. Jeżeli zmiana liczby neutrofili jest związana z infekcją bakteryjną, wirusową lub grzybiczą, to wraz ze zdrowieniem liczba tych komórek będzie wracać do normy.

Neutrofile to komórki należące do krwinek białych, które odgrywają bardzo ważną rolę w obronie organizmu przed patogenami. Ich zdolność do przeprowadzania procesu fagocytozy oraz zawartość związków przeciwdrobnoustrojowych w ziarnistościach sprawia, że są niezbędne do utrzymywania prawidłowej odporności. Oznaczenie liczby neutrofili można wykonać wykorzystując do tego proste badanie, jakim jest morfologia krwi obwodowej. Wszelkie odchylenia dotyczące liczby neutrofili lub innych składowych morfologii powinno się skonsultować z lekarzem.

Bibliografia

- A. Szczeklik i inni, Choroby wewnętrzne, PZWL 2018/2019,

- A. Dembińska-Kieć i inni, Diagnostyka laboratoryjna z elementami biochemii klinicznej, Urban & Partner, Wrocław 2005 (dodruk), s. 654–659,

- E. Bańkowski, Biochemia podręcznik dla studentów uczelni medycznych. Wrocław: Elsevir Urban & Partner, 2010,

- S. Dockree i inni, White blood cells in pregnancy: reference intervals for before and after delivery, ebioMedicine, Volume 74, December 2021.